生成AI時代の「著作権」と「セキュリティ」。実務で絶対NGなこと

ChatGPTやMidjourney、Stable Diffusionなどの生成AIは、ビジネスの速度を劇的に加速させました。もはやAIを使わないという選択肢は、現代のビジネスにおいて「竹槍で戦車に挑む」ようなものです。

しかし、その便利さの裏には、企業を一瞬で倒産させかねない巨大なリスクが潜んでいます。それが「著作権侵害」と「情報漏洩」です。

趣味で使う分には問題ありません。しかし、プロとして、実務としてAIを扱う場合、絶対に踏んではいけない地雷が存在します。

「知らなかった」では済まされない。

今回は、アクトハウスがカリキュラムの中で徹底的に叩き込む、AI時代の法務・セキュリティリテラシーについて解説します。これを知らないまま現場に出ることは、無免許で高速道路を走る行為と同じです。

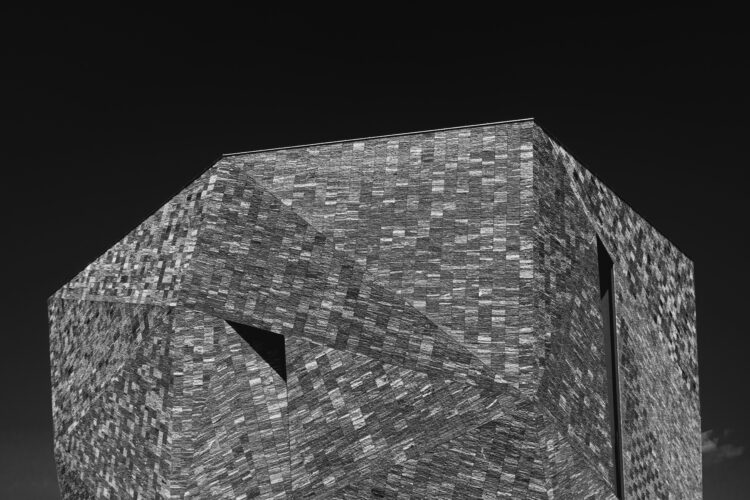

その画像、本当に使って大丈夫ですか?

生成AIにおける最大のリスクの一つが、著作権です。

「AIが作ったものだから著作権フリー」という認識は、極めて危険な誤解です。

特に画像生成AIにおいて、特定のアーティストや既存のキャラクターの画風を意図的に模倣させるプロンプト(指示)を使用した場合、出力された画像は著作権侵害に当たる可能性が極めて高くなります。

また、偶然似てしまった場合でも、商用利用した瞬間に訴訟リスクが発生します。

実務で絶対NGなのは、「生成された画像を、そのまま商標やロゴとして登録しようとすること」です。

現在の法律(特に米国や日本の一部の解釈)では、AIのみで生成された制作物には著作権が発生しないケースが多く、自社の権利を守れないばかりか、他社の権利を侵害しているリスクを抱え続けることになります。

アクトハウスでは、「Logic Prompt」の一環として、リスク回避のためのプロンプト設計を学びます。

「既存の作品を学習元として強く反映させない指示の出し方」や、生成物をそのまま使うのではなく、人間が手を加えて(加筆・修正して)オリジナリティを付与するプロセス。これらを経て初めて、AI生成物は「商品」として成立します。

コピペした瞬間、機密情報が世界中に漏れる

エンジニアやライターが最もやりがちな致命的なミス。

それは、「クライアントの未公開情報や、社内の機密データを、そのままChatGPTに入力してしまうこと」です。

多くの生成AIサービスにおいて、デフォルトの設定では、入力されたデータは「AIの学習データ」として再利用されます。

つまり、あなたがChatGPTに「この新商品のPR文を考えて(商品詳細データ)」と入力した瞬間、その商品情報はAIのデータベースに吸い込まれ、世界中の誰かが「◯◯社の新商品について教えて」と聞いた時に、回答として漏洩してしまう可能性があるのです。

これは、NDA(秘密保持契約)違反であり、損害賠償請求の対象となる「ビジネス上の自殺行為」です。

実務における鉄則は以下の通りです。

1. 設定で学習への利用をオプトアウト(拒否)する。

2. そもそも固有名詞や機密数字は伏せ字(マスキング)にして入力する。

3. API経由など、データが学習されないセキュアな環境を利用する。

アクトハウスの後半100日の実務カリキュラムでは、実際の企業の案件を扱います。もし学生がこのセキュリティルールを破り、クライアントの情報を不用意にAIに入力した場合、それは「学習中のミス」では済まされません。実際の現場であれば即解雇レベルの事案として、厳しく指導が入ります。

ハルシネーション(AIの嘘)に対する責任

生成AIは、平気で嘘をつきます。これを「ハルシネーション(幻覚)」と呼びます。

もっともらしい文脈で、存在しない法律や、架空の判例、間違ったコードを出力することが日常茶飯事です。

実務で絶対NGなのは、「AIの出力を裏取り(ファクトチェック)せずにそのまま納品すること」です。

コードであれば動かないだけで済みますが、契約書や医療情報、Web記事などでこれをやれば、信用問題に発展します。

AIを使う人間の最大の役割は、「生成」ではなく「監修(ディレクション)」です。

出力された情報の真偽を確かめ、論理の破綻を修正し、責任を持てる状態にして世に出す。この「最後の砦」としての能力がなければ、AIオペレーターとしての価値はありません。

企業が欲しがっているのは「怖さを知っている人」

今、企業が採用したいのは「AIを使ってすごいものが作れる人」だけではありません。

それ以上に、「AIのリスクを正しく理解し、安全に使いこなせる人」を求めています。

情報漏洩のリスク管理ができるか。

著作権のグレーゾーンを理解して立ち回れるか。

AIの嘘を見抜けるだけの基礎知識(プログラミングやビジネスの知識)があるか。

この「守りのリテラシー」がない人材に、最新のツールを渡すことはできません。

アクトハウスが、単なる技術だけでなく「ビジネス(Strategy)」「法務・倫理観」を含めたビジネステック教育を行う理由はここにあります。

AIという強力なエンジンを積むなら、同時に高性能なブレーキとハンドル操作を学ばなければ、事故を起こして終わるからです。

自分の頭で考えることを放棄しない

最後に、最も本質的なNG行為を挙げます。

それは、「思考のプロセスを全てAIに丸投げすること」です。

AIはあくまで「優秀な部下」であり、意思決定を行うのはあなたです。

「AIがこう言ったから」と言い訳する人間は、プロではありません。なぜそのコードを選んだのか、なぜそのデザインにしたのか。その理由を自分の言葉で論理的に説明できて初めて、クライアントからの信頼を得られます。

アクトハウスの180日間は、AI時代における「人間の価値」を再定義する時間でもあります。

テクノロジーを使い倒しながらも、決してテクノロジーに使われない。

そんな強靭な知性と倫理観を持ったプロフェッショナルを目指すなら、ここは最適な修練の場となるでしょう。

リスクを知ることは、臆病になることではありません。

リスクを知るからこそ、誰よりも大胆に、アクセルを踏み込めるようになるのです。

著者:清宮 雄(アクトハウス代表) 起業家・ブランドアーキテクト。2014年にセブ島でIT留学の草分けアクトハウスを設立。「ビジネス×テック」をテーマに、時代に左右されない強靭な個の育成に従事。